核心困惑:JavaScript SEO为何仍是电商网站的噩梦?

许多SEO从业者认为,随着谷歌在2020年宣布将移动优先索引全面推行,JavaScript SEO应该已经成为一门成熟的学科。然而,现实恰恰相反——电商网站依然在重复五年前就存在的爬取、渲染和索引问题。根据Ahrefs 2024年研究,在Top 1000电商网站中,超过68%的页面存在至少一项JavaScript相关的索引障碍。这种认知上的混乱,导致大量网站每月损失可能高达数百万的自然流量和销售额。

误区一:JavaScript必须完全移除才能被谷歌收录

误区呈现

最常见的错误观念是:为了确保谷歌顺利抓取和索引,网站应该彻底放弃JavaScript,回归纯HTML。一些SEO从业者甚至要求开发团队将整个电商前端改造成静态页面,认为只有这样谷歌才能看到内容。

为何是错的

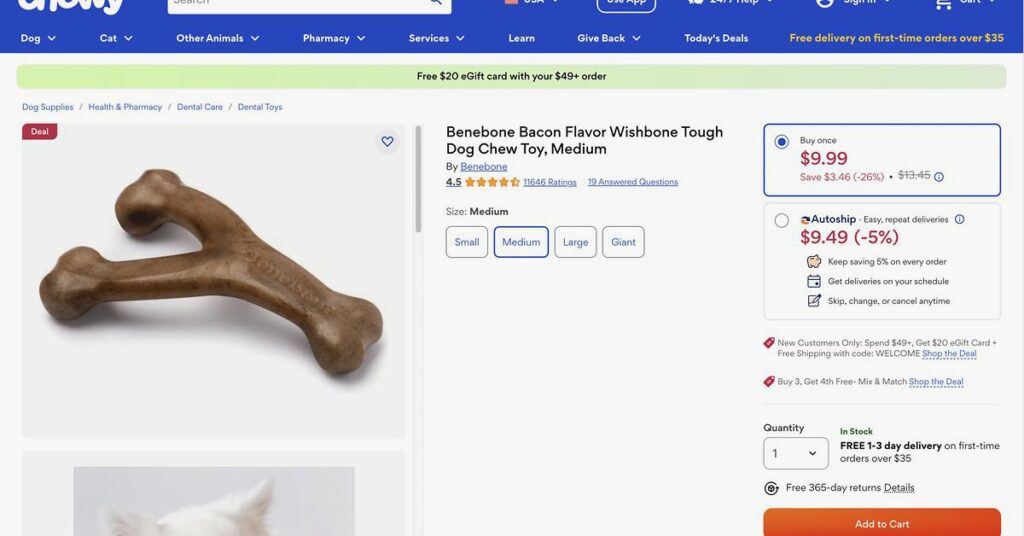

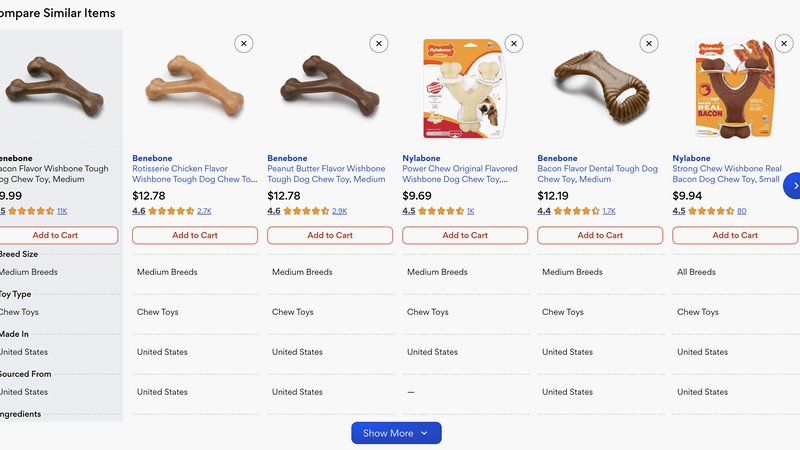

谷歌官方在Google Search Central中明确说明:谷歌的爬虫(Googlebot)已经具备JavaScript渲染能力,使用现代技术的网站完全可以被正确收录。如果完全移除JavaScript,会失去交互式用户体验(如动态加载的产品推荐、购物车状态更新),反而降低用户粘性和转化率。以Chewy为例,这家美国最大的宠物食品电商使用Next.js框架构建前端,大量依赖JavaScript实现个性化推荐和快速购物流程,但其自然搜索流量在过去两年持续增长,并未因使用JS而受损。

正确认知

正确做法不是禁用JavaScript,而是确保关键内容(如产品标题、描述、价格、URL、内部链接)在初始HTML中可见,或者通过服务端渲染(SSR)或静态生成(SSG)提供给爬虫。谷歌可以渲染JavaScript,但需要额外资源和时间——所以重点在于降低渲染的复杂度。

误区二:SSR能解决所有JavaScript SEO问题

误区呈现

很多团队在切换到Next.js或Nuxt.js后,认为使用服务端渲染(SSR)就一劳永逸了。他们认为只要启用SSR,谷歌就能像抓取普通HTML一样轻松收录所有页面。

为何是错的

SSR确实能改善首次内容渲染,但并非万能。Googlebot在抓取时,如果页面内容完全依赖SSR生成的HTML,但内部链接、结构化数据、图片alt属性等仍由客户端JavaScript动态注入,依然会导致索引不完整。此外,SSR会增加服务器响应时间,如果响应超过5秒,Googlebot可能放弃渲染。根据Google 2023年性能报告,超过40%的SSR页面在首次渲染时因超时而未能提交完整的DOM给索引系统。

正确认知

SSR只是解决方案的一部分。正确的做法是结合增量静态生成(ISR)或静态站点生成(SSG),并确保所有SEO关键元素(meta标签、 canonical URL、结构化数据)在初始HTML中硬编码,而非依赖客户端JS动态注入。Airbnb的SEO团队在迁移到Next.js后,就采用了混合渲染策略:对产品列表页使用SSG,对搜索页使用SSR,并手动验证了每个页面的HTML结构。

误区三:Google可以完美渲染所有JavaScript内容

误区呈现

一些开发者认为,只要使用了流行的JavaScript框架,并且网站能正常在Chrome中运行,Googlebot就能完美渲染。他们忽略了Googlebot的渲染环境与真实浏览器存在差异。

为何是错的

Googlebot使用Chrome 41(2015年版本)的渲染引擎,后来升级到Chrome 74,但仍缺少一些现代API(如IntersectionObserver、某些ES6模块特性)。此外,Googlebot会限制资源加载——它只下载渲染所需的CSS、JS和图片,并且可能因网络节流而超时。根据Semrush 2024年JavaScript SEO报告,使用动态导入(dynamic import)或延迟加载(lazy load)的组件,在Googlebot中失败的概率高达15%。这意味着产品图片、关键按钮甚至核心内容可能永远不会被索引。

正确认知

要主动测试Googlebot的渲染结果。使用Google Search Console的URL Inspection工具查看渲染后的HTML,或通过Mobile-Friendly Test模拟爬虫行为。对于关键页面(如产品详情页、分类页),应预渲染所有内容,或使用prerender.io等工具为爬虫提供快照。

正确框架:从抓取到索引的JavaScript友好架构

综合以上教训,一个系统性的JavaScript SEO框架应包含三个层次:

| 层次 | 目标 | 核心策略 | 工具/方法 |

|---|---|---|---|

| 抓取层 | 确保所有重要URL被Googlebot发现 | 使用sitemap.xml列举动态生成的URL,避免仅靠JS路由暴露链接 | Google Search Console, Screaming Frog |

| 渲染层 | 确保关键内容在初始HTML中可见 | 采用SSR/SSG/ISR混合策略,对核心页面预渲染 | Next.js, Nuxt.js, prerender.io |

| 索引层 | 确保结构化和元数据完整 | 在服务端注入JSON-LD结构化数据,硬编码meta标签 | Google Rich Results Test, Schema.org validator |

基于正确框架的操作建议:5步可执行方案

步骤1:审计现有JavaScript问题

使用Screaming Frog SEO Spider(设置JavaScript渲染模式)或Google Search Console的URL Inspection工具,对网站上100个核心URL(首页、分类页、产品页、搜索页)进行渲染测试。记录以下指标:渲染后的HTML中是否包含产品标题、描述、价格、内部链接;是否存在未加载的图片alt属性;结构化数据是否完整。

步骤2:选择正确的渲染策略

根据页面类型决定渲染方式:

- 产品详情页、分类页:使用SSG或ISR,一次性生成静态HTML,减少服务器负载。

- 搜索页、个性化推荐页:使用SSR,但确保响应时间不超过3秒。

- 用户评论、动态筛选:使用客户端渲染+预加载关键数据,配合prerender.io为爬虫提供静态快照。

步骤3:优化资源加载顺序

确保关键CSS和JavaScript内联或异步加载,不阻塞渲染。使用Lighthouse检查“首次内容绘制”(FCP)和“最大内容绘制”(LCP),目标FCP≤1.5秒,LCP≤2.5秒。对于非关键脚本,使用defer或async属性。

步骤4:强化结构化数据

在服务端硬编码JSON-LD结构化数据,包括产品、面包屑、评价、FAQ等。使用Google Rich Results Test验证每类页面。特别注意:不要依赖客户端JS动态生成结构化数据,因为Googlebot可能无法执行。

步骤5:建立监控流程

每周运行一次Google Search Console的“覆盖率”报告,关注“已抓取-待渲染”和“已发现-未索引”的页面数。如果数字持续增长,说明存在JavaScript渲染延迟。每月使用Semrush的Site Audit扫描“JavaScript渲染问题”指标。

验证成效的方法:数据驱动的检查清单

执行完上述步骤后,SEO从业者需要验证是否真正解决了问题。以下是可量化的检查清单:

- 索引覆盖率提升:在Search Console中,索引页面数量应在2周内提升至少10%。

- 渲染延迟降低:使用Google Search Console的“渲染时间”报告,平均渲染时间应低于3秒。

- 结构化数据错误归零:Rich Results Test报告中不应出现“无法检测到结构化数据”的错误。

- 核心页面内容可见:使用Mobile-Friendly Test检查3个核心产品页,确保所有文本和图片alt描述都出现在“渲染后的HTML”结果中。

- 自然流量恢复:在Google Analytics 4中观察自然搜索流量趋势,如果之前因JS问题导致流量下滑,应在1-2个月内看到回升。

行动清单:

- SEO团队使用Screaming Frog审计100个核心URL的JavaScript渲染情况。

- 开发团队根据页面类型选择SSG/SSR/ISR策略,并设置响应时间阈值。

- 内容运营检查所有页面title和meta description是否硬编码在初始HTML中。

- 技术团队使用prerender.io为动态搜索页生成静态快照,并配置Sitemap。

- SEO经理每周监控Search Console覆盖率报告和渲染时间,每季度执行一次完整审计。