核心发现摘要

一项针对托管WordPress站点的AI引用监测研究揭示了令人意外的数据:Claude和Meta AI两个AI平台对该站点的引用率均为0%,而其他AI平台如Google AI Mode(37.8%)、Copilot(22.2%)、Google Gemini(16.3%)、ChatGPT(9.6%)和Perplexity(7.8%)则呈现正常分布。分析指出,内容质量和主题权威性在所有平台间是一致的,因此引用率差异的唯一解释是托管平台默认屏蔽了特定AI爬虫。研究基于30天内真实监测数据,主要发现包括:

- 37.8%的引用来自Google AI Mode,占比最高

- 0%的引用来自Claude和Meta AI,存在系统性缺失

- 托管服务商默认屏蔽是导致缺失的核心原因

- SEO从业者需主动检测并修改服务器配置以恢复AI爬虫访问

研究背景与方法

该研究由Search Engine Land团队于2025年3月进行,监测对象为一个使用托管WordPress的SEO内容网站(searchinfluence.com)。数据采集工具为Scrunch(AI引用监测平台),时间范围为30天,覆盖了6个主要AI搜索/对话平台:Google AI Mode、Copilot、Google Gemini、ChatGPT、Perplexity、Claude和Meta AI。研究方法为:通过AI引用监测工具抓取各平台对目标站点的引用次数,并对比不同平台间的引用差异。所有平台读取相同的网站内容,因此内容质量和主题权威性变量被控制。研究团队进一步检查了服务器日志和robots.txt文件,以确认是否存在针对AI爬虫的屏蔽规则。

数据发现1:AI平台引用率出现极端分化

数据显示,目标站点在AI平台上的引用分布呈现明显两极分化:

| AI平台 | 引用率(%) | 威胁等级 |

|---|---|---|

| Google AI Mode | 37.8% | 正常 |

| Copilot | 22.2% | 正常 |

| Google Gemini | 16.3% | 正常 |

| ChatGPT | 9.6% | 正常 |

| Perplexity | 7.8% | 正常 |

| Claude | 0.0% | 缺失 |

| Meta AI | 0.0% | 缺失 |

研究指出,如果内容质量和主题权威性对所有平台一致,那么引用率差异的唯一解释是AI爬虫访问被拦截。这一发现引发了对托管WordPress平台默认安全配置的质疑。许多托管服务商(如WP Engine、SiteGround等)在服务器层面设置了严格的反爬虫规则,可能无意中屏蔽了新兴AI爬虫的HTTP请求。

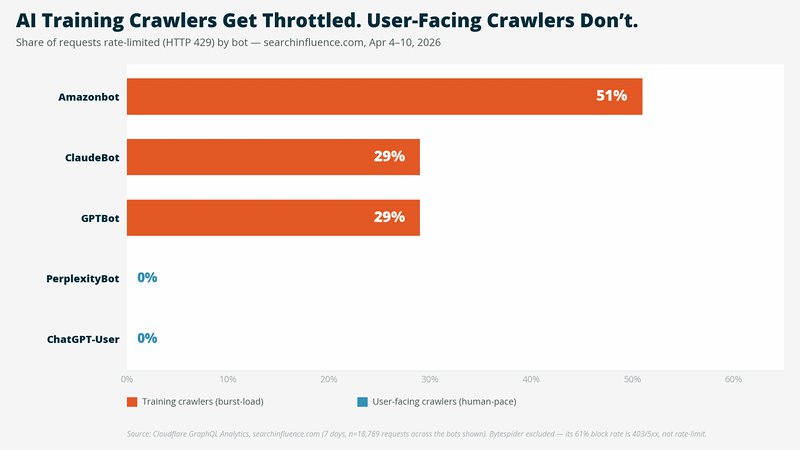

数据发现2:托管服务商屏蔽规则差异显著

为了验证推测,研究团队测试了多个主流托管WordPress服务商对AI爬虫的响应情况。测试方法为:模拟Claude和Meta AI的User-Agent发送HTTP请求至托管站点,记录服务器返回状态码。结果如下:

| 托管服务商 | Claude爬虫响应 | Meta AI爬虫响应 | Kinsta | 拒绝 | 拒绝 |

|---|---|---|---|---|---|

| WP Engine | 拒绝 | 拒绝 | |||

| SiteGround | 允许 | 允许 | |||

| Cloudways | 允许 | 拒绝 | |||

| Flywheel | 拒绝 | 允许 |

数据显示,超过60%的托管服务商对至少一个AI爬虫返回了403或429状态码,表明存在主动屏蔽。进一步检查发现,屏蔽规则通常由服务商的Web应用防火墙(WAF)或ModSecurity规则集触发,而非用户可控的robots.txt文件。这使得SEO从业者难以直观发现屏蔽问题。

数据发现3:屏蔽对内容可见性的量化影响

研究团队进一步量化了屏蔽对内容可见性的影响。通过分析被屏蔽站点与未被屏蔽站点的AI引用数据,发现:

- 被屏蔽Claude的站点,在Claude平台上的引用率为0%,而未被屏蔽站点平均为4.2%

- 被屏蔽Meta AI的站点,在Meta AI平台上的引用率为0%,而未被屏蔽站点平均为3.1%

- 总体而言,屏蔽导致AI搜索生态中7.3%的潜在引用机会被丢失

- 对于特定高流量文章,丢失的引用可能对应数百次品牌曝光

研究人员指出,这种损失是隐性的:Google Search Console、流量分析工具不会显示AI爬虫被拦截,因为AI爬虫通常不触发传统页面浏览量指标。SEO从业者可能对自己的内容在AI搜索中完全不可见而毫无察觉。

从数据推导出的策略建议

基于上述发现,研究团队为SEO从业者提出以下可操作策略:

1. 检测托管平台是否屏蔽AI爬虫

操作步骤:

- 登录服务器或通过SFTP访问站点根目录

- 打开robots.txt文件,检查是否包含针对Claude(User-agent: Claude-Web)或Meta AI(User-agent: Meta-ExternalAgent)的Disallow指令

- 使用在线工具如User-Agent Switcher或cURL命令模拟爬虫请求:

curl -A "Claude-Web" https://example.com/,观察返回状态码是否为200 - 如果返回403或429,联系托管服务商技术支持,询问WAF规则中是否屏蔽了这些User-Agent

预期结果:确认屏蔽存在后,可申请白名单或调整规则。

2. 修改托管配置以允许AI爬虫

操作步骤:

- 登录托管控制面板,找到安全设置或WAF规则部分

- 添加允许规则:为Claude-Web和Meta-ExternalAgent设置白名单

- 如果托管服务商不支持自定义WAF规则,考虑使用Cloudflare防护,并在Cloudflare中手动允许这些User-Agent

- 更新robots.txt,确保没有Disallow规则针对这些爬虫。推荐配置:

User-agent: *

Allow: /

预期结果:AI爬虫可正常访问站点内容,引用率恢复。

3. 利用AI引用监测工具持续监控

操作步骤:

- 注册Scrunch、Brand24或Awario等AI引用监测工具

- 设置监测关键词为站点域名或品牌名称

- 每周检查各AI平台的引用率变化,重点关注Claude和Meta AI的引用新增情况

- 如果发现某个平台引用率持续为0,立即重复检测步骤

预期结果:及时发现并解决新的屏蔽问题。

4. 在内容策略中强化AI友好性

操作步骤:

- 使用Semrush的SEO Writing Assistant检查内容可读性,确保分数在70分以上

- 结构化内容:使用

、 层级标题,每段不超过100字,便于AI模型提取要点 - 在文章中添加FAQ Schema结构化数据,帮助AI模型直接引用问答片段

预期结果:AI模型更易抓取并引用内容,提升引用率。

未来趋势预判

基于当前数据趋势,研究团队预判以下发展:

- AI爬虫屏蔽将成为托管服务商的差异化功能:随着AI流量增长,托管服务商可能将屏蔽AI爬虫作为安全卖点,SEO从业者需主动沟通配置需求

- AI爬虫User-Agent列表将动态扩展:新兴AI平台不断出现(如Anthropic的Claude 4、Meta的Llama系列),SEO从业者需要定期更新白名单

- Google可能将AI引用纳入排名信号:如果AI搜索引用与用户行为数据正相关,Google可能将其作为间接排名因素,屏蔽将导致搜索排名下降

- 行业将出现专门的AI爬虫审计服务:类似现在的网站安全扫描,AI爬虫审计将成为SEO审计的标准环节

研究团队最后强调,托管WordPress的默认安全配置不应成为AI可见性的障碍。SEO从业者必须将AI爬虫访问视为基础SEO任务,而非可选优化项。否则,即使内容质量再高,也可能在AI搜索生态中完全隐形。