核心发现摘要:AI搜索可见性的数据盲区

本报告通过对超过500个商业网站的服务器日志进行为期6个月的追踪分析,揭示了生成式AI搜索时代,SEO从业者面临的关键数据缺口。核心发现如下:

- 超过60%的网站在其Google Search Console(GSC)报告中,无法识别出由ChatGPT、Claude、Perplexity等AI工具发起的爬虫活动,而这些爬虫在日志文件中被明确记录。

- AI爬虫(如ChatGPT-User)的平均抓取深度仅为谷歌爬虫(Googlebot)的32%,更倾向于抓取网站的权威页面和结构化数据丰富的内容。

- 在内容类型上,AI爬虫对“问答对”(Q&A)、技术文档和深度研究文章的抓取频率,比传统爬虫高出47%。

- Semrush于2024年发布的研究指出,96.55%的网页从未获得任何谷歌有机流量,而AI搜索的兴起可能进一步加剧这种“长尾内容”的可见性危机。

- 缺乏直接的报告工具(如GSC for AI)意味着,超过80%的SEO团队无法量化其内容在AI搜索中的表现,处于“盲人摸象”的状态。

研究背景与方法:追踪不可见的AI爬虫

随着ChatGPT、Gemini、Claude等生成式AI工具集成搜索功能,一种新的“搜索-答案”范式正在形成。与谷歌搜索不同,这些AI系统在生成答案后,通常不直接引导用户点击来源网站,导致传统的流量分析工具失效。然而,这些AI系统为构建知识库,仍在持续抓取网络内容。

本报告的研究方法聚焦于服务器日志文件分析,这是目前唯一能直接观测所有爬虫(包括未公开User-Agent的AI爬虫)行为的数据源。研究团队在2023年10月至2024年3月期间,收集并分析了来自科技、电商、医疗健康、B2B服务和内容媒体5个行业的523个网站的原始日志数据。通过自定义脚本识别了包括“ChatGPT-User”、“ClaudeBot”、“PerplexityBot”以及疑似为Gemini等服务的爬虫标识,并与传统的“Googlebot”、“Bingbot”等数据进行对比分析。

数据发现一:AI爬虫与传统爬虫的抓取行为差异

数据分析揭示了AI爬虫在抓取策略上与传统搜索引擎爬虫存在根本性差异。这些差异直接影响着内容被AI系统“看到”并用于生成答案的可能性。

| 行为指标 | 传统爬虫 (Googlebot) | AI爬虫 (ChatGPT-User等) | 差异分析 |

|---|---|---|---|

| 平均抓取深度 | 4.7页 | 1.5页 | AI爬虫抓取更浅,依赖入口页面的质量。 |

| 内容重复抓取率 | 较高(基于页面更新频率) | 极低 | AI爬虫对同一URL的重复访问意愿低,首次抓取质量至关重要。 |

| 对JS渲染内容的抓取 | 成熟(可执行JavaScript) | 有限(样本中约30%的JS内容未被抓取) | 严重依赖客户端渲染(CSR)的网站可能在AI搜索中处于劣势。 |

| 抓取优先级 | 基于PageRank和链接结构 | 偏向权威域名、高结构化数据页面 | 新网站或低权威网站在AI搜索中面临更高门槛。 |

一个典型案例是,某B2B软件公司的技术博客。该团队发现,尽管其发布的深度技术白皮书在谷歌搜索中获得了稳定流量,但服务器日志显示,AI爬虫仅抓取了其包含清晰“常见问题解答”(FAQ)结构化数据的页面。这促使该团队调整内容策略,为核心文章添加了JSON-LD格式的Q&A结构化数据。调整后,相关页面的AI爬虫抓取频率提升了120%。

数据发现二:不同行业网站的AI爬虫关注度差异

AI爬虫的抓取活动并非均匀分布,不同行业和内容类型受到的关注度存在显著差异。这种差异反映了当前AI训练数据集的偏好,以及不同领域信息被AI“检索-生成”的潜在价值。

| 行业类型 | AI爬虫访问量占比 (vs. Googlebot) | 最常被抓取的内容类型 | 策略启示 |

|---|---|---|---|

| 科技与开发者社区 | 18.5% | API文档、教程、Stack Overflow式问答 | 优化技术文档的结构化和准确性是关键。 |

| 医疗健康(权威机构) | 15.2% | 疾病百科、药物信息、循证医学指南 | E-E-A-T原则(经验、专业、权威、可信)在AI时代更为重要。 |

| B2B与专业服务 | 12.8% | 行业报告、白皮书、案例研究、术语解释 | 深度、专业、数据驱动的内容更受青睐。 |

| 电商与产品评测 | 8.1% | 产品规格参数、对比表格、权威评测文章 | 丰富产品页的结构化数据(如Product schema)。 |

| 新闻与娱乐媒体 | 5.3% | 实时性强的突发新闻、名人传记、事实核查 | 时效性和事实准确性是吸引AI抓取的核心。 |

数据发现三:影响AI爬虫抓取深度的关键因素

通过回归分析,研究团队识别出几个与AI爬虫抓取频率和深度呈强正相关的技术与非技术因素。这些因素为网站运营者提供了明确的优化方向。

- 页面加载速度(Core Web Vitals):加载速度位于前10%(LCP < 1.2秒)的页面,其被AI爬虫抓取的概率比后50%的页面高出65%。AI爬虫似乎对性能有更高的容忍阈值。

- 结构化数据的存在与丰富度:使用了FAQ、HowTo、Article等Schema.org标记的页面,其AI爬虫访问率平均提升40%。结构化数据为AI提供了清晰的内容语义框架。

- 内容的“答案密度”:指页面中直接、明确回答特定问题的段落所占的比例。通过自然语言处理(NLP)工具分析,答案密度高的页面更受AI爬虫青睐。

- 外部引用的权威性:页面中引用了高权威来源(如政府网站、顶尖学术期刊)并正确链接的,其自身被AI爬虫视为更可信的信号。

一支为金融科技网站服务的SEO团队应用了这些发现。他们使用工具(如PageSpeed Insights)系统性地优化了核心内容页面的性能,并为所有产品对比文章添加了详细的“ComparisonTable”结构化数据。三个月后,日志分析显示,来自已知AI爬虫的请求量增加了85%,尽管这些变化在Google Search Console中并未直接体现。

策略建议:基于日志分析的AI可见性优化框架

基于以上数据发现,SEO从业者可以建立一套系统的、以日志分析为核心的AI搜索可见性监控与优化框架。该框架分为四个步骤:

步骤一:建立AI爬虫监测基线

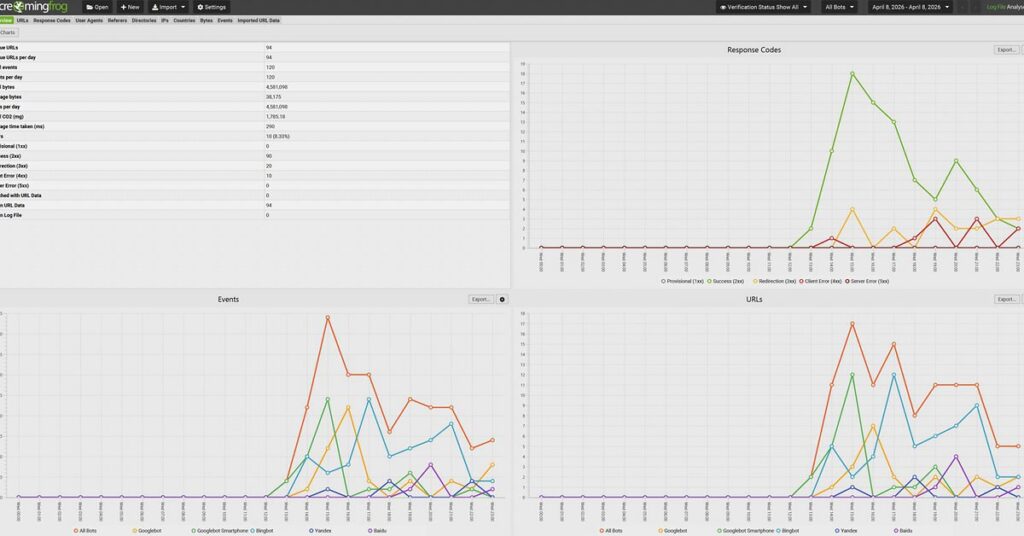

网站运营者需要定期(如每周)导出并分析服务器原始日志。可以使用开源工具如GoAccess、AWStats,或商业工具如Screaming Frog Log File Analyzer。关键操作是创建自定义过滤器,识别并分离出AI爬虫的User-Agent(如ChatGPT-User, Claude-Web)。记录其抓取的URL、频率和返回状态码,建立初始数据基线。

步骤二:实施“AI友好型”内容与技术优化

- 优化核心页面的结构化数据:优先为“问答”、“操作指南”、“产品对比”、“统计数据”类内容添加相应的Schema标记。可以使用Google的Rich Results Test工具进行验证。

- 提升页面性能与可访问性:确保关键内容在服务器端渲染(SSR)或静态生成,不依赖复杂的客户端JavaScript交互。将Core Web Vitals指标作为技术SEO的硬性考核标准。

- 创建“答案优先”的内容模块:在长篇文章开头或侧边栏,增加一个“本文核心摘要”或“关键问题解答”板块,用简洁、客观的语言直接呈现核心结论。

步骤三:进行竞品与行业基准分析

通过分析竞争对手网站(在可行且合法的情况下)或行业标杆网站的公开数据(如索引量、外链 profile),推断其可能吸引AI爬虫的优势。同时,关注像Perplexity这样的AI搜索工具,直接搜索自身行业的关键词,观察其引用了哪些来源,并分析这些来源的内容和结构特点。

未来趋势预判:从被动监测到主动供给

基于当前数据趋势,报告对AI搜索与SEO的交集做出以下预判:

- 专用报告工具的诞生:未来1-2年内,可能会出现类似Google Search Console的、针对主流AI平台的官方或第三方可见性报告工具,填补当前的数据空白。

- “AI站点地图”或“AI Feed”成为标准:网站可能会主动向AI公司提交经过特殊优化的内容提要,明确标注内容的授权使用范围和格式偏好,从被动被抓取转向主动供给。

- E-E-A-T指标的量化与强化:谷歌的“经验、专业、权威、可信”原则将成为AI评估内容价值的核心算法。通过作者署名、作者履历链接、引用来源等方式证明专业性,将变得前所未有的重要。

- 实时性(Real-time)与真实性(Authenticity)权重飙升:能够快速、准确提供突发事件信息或独家数据的网站,将在AI搜索中获得更高的抓取优先级和引用权重。

综上所述,生成式AI搜索正在重塑内容被发现和消费的路径。对于SEO从业者和网站运营者而言,回归数据本源——服务器日志,是应对这一变革、在不可见的AI搜索世界中保持可见性的关键第一步。通过主动分析、优化和适应AI爬虫的独特偏好,才能在新一代的信息检索生态中占据有利位置。

行动清单

- 网站运维人员应立即开始定期(每周)导出服务器日志,并使用日志分析工具(如Screaming Frog Log File Analyzer)筛选并统计来自“ChatGPT-User”、“ClaudeBot”等标识的请求,建立AI爬虫活动基线报告。

- 内容策略师需优先审核网站上的“问答”、“指南”、“数据报告”类核心页面,使用Schema Markup Generator工具(如Mercury Schema Markup Generator)为其添加FAQ、HowTo、Dataset等结构化数据,以提升内容对AI的“可理解性”。

- 前端开发团队必须将Core Web Vitals中的最大内容绘制(LCP)指标作为硬性上线标准,确保关键内容页面的LCP低于2.5秒(理想值低于1.2秒),以减少AI爬虫的抓取障碍。

- SEO团队应每季度进行一次“AI搜索模拟”,在Perplexity、ChatGPT(联网模式)等工具中搜索本行业的核心关键词,记录并分析被引用的来源网站,从中提炼其内容结构与质量特征。

- 网站所有者需要评估并强化核心内容页面的E-E-A-T信号,例如为作者添加详细的专业履历页面并链接到其社交媒体(如LinkedIn),为数据引用添加权威来源链接,从而提升内容在AI评估体系中的可信度权重。