痛点:你的内容正在被AI搜索“隐形降权”

想象一下:你投入数月,精心创作了一篇关于“2024年最佳降噪耳机”的深度评测,包含了详细的参数对比、真实用户体验和实验室数据。在传统谷歌搜索中,它可能排名第3,每天带来稳定流量。但今天,当用户在谷歌搜索框中输入同样的问题时,屏幕顶端直接出现了谷歌搜索生成体验(SGE)的AI摘要框,它综合了多个来源的信息,给出了一个看似全面的答案列表。你的网站链接呢?被折叠在了这个AI生成的答案下方,甚至可能完全未被提及。

这不是未来,而是正在发生的现实。根据Ahrefs 2024年的研究,一个残酷的数据是:96.55%的网页从未从谷歌获得过任何自然搜索流量。在生成式搜索时代,如果你的内容无法被AI代理(如谷歌SGE、Perplexity AI、微软Copilot)有效抓取、理解和信任,那么你连进入那可怜的3.45%的机会都将丧失。你的内容不是排名下降,而是直接“消失”在AI生成的答案背后。

本文要解决的,就是这个最迫切的痛点:如何通过技术SEO调整,确保你的网站不仅是“可索引的”,更是“AI友好、可被信任并乐于引用的”。读完本文,你将获得一套具体的、可立即上手的操作框架。

核心转变:从“被索引”到“被理解与引用”

传统技术SEO的核心目标是确保谷歌爬虫能顺利发现、抓取和索引你的页面。但在生成式搜索(GEO)的范式下,目标发生了根本性转移。AI代理的工作流程是:访问 → 提取 → 理解 → 综合 → 生成答案。 你的技术优化必须服务于这个新链条。

这意味着,你需要思考:

- AI代理能顺利访问我的所有关键内容吗?(访问控制)

- 我的内容结构是否清晰到让AI能准确提取关键事实和数据?(内容结构)

- AI如何判断我的内容是可靠、权威、值得引用的?(信任信号)

下面的章节,我们将围绕这三个核心问题,展开具体的操作步骤。

第一步:管理AI代理访问控制(Agentic Access Control)

本节解决:如何确保各种AI爬虫能像谷歌爬虫一样,畅通无阻地访问你希望它们看到的内容。

AI代理并非只有谷歌一家。除了谷歌的SGE爬虫(可能使用特殊User-Agent),还有来自Perplexity、Claude、ChatGPT等模型的爬虫在扫描网络。如果你的`robots.txt`文件或服务器设置错误地屏蔽了它们,你的内容从一开始就失去了被引用的资格。

操作步骤:审核与配置你的爬虫访问权限

- 识别AI爬虫:定期检查服务器日志(使用如Screaming Frog Log File Analyzer工具),查找非传统谷歌爬虫的访问记录。关注User-Agent中包含“AI”、“GPT”、“Claude”、“Perplexity”、“Bard”等字样的流量。

- 审查robots.txt文件:确保你没有使用过于宽泛的`Disallow`指令,意外屏蔽了所有非知名爬虫。对于你希望被AI引用的内容区域(如博客、知识库、产品规格页),应保持开放。

- 实施精细化的`robots.txt`策略:与其一概而论,不如针对不同目录进行设置。例如,你可以允许所有爬虫访问`/blog/`和`/knowledge-base/`,但限制对`/admin/`和`/cart/`的访问。

案例:某科技新闻网站的访问策略调整

场景:一个科技新闻网站发现其深度分析文章很少被AI摘要引用。

问题:检查发现,其`robots.txt`中有一条旧规则,禁止所有未明确列出的爬虫访问`/articles/`目录,以节省服务器资源。

操作:SEO团队分析了日志,识别出多个AI研究爬虫被拒之门外。他们移除了这条宽泛的禁止规则,改为仅禁止已知的恶意爬虫。

结果:3周后,通过监控品牌提及和SGE测试,发现其文章中的关键数据和结论被AI摘要引用的频率提升了40%。

第二步:优化内容结构,便于AI提取与验证

本节解决:如何将你的内容“包装”成AI最喜欢“消化”的格式,让关键信息一目了然。

AI代理在生成答案时,需要快速、准确地从页面中提取核心事实、数据、步骤和结论。杂乱无章的文本、信息深藏在多层交互元素(如Tab、折叠面板)中,都会增加AI的提取难度和出错率。

核心操作:采用模式化、层级化的内容结构

- 系统化使用Schema标记:这是最重要的技术动作之一。为你的内容添加相关的Schema.org结构化数据。例如:

- 文章/博客:使用`Article`或`BlogPosting`类型,明确标记`headline`、`author`、`datePublished`、`mainEntityOfPage`。

- 产品/服务:使用`Product`类型,标记`name`、`description`、`brand`、`aggregateRating`。

- 操作指南:使用`HowTo`类型,一步步列出`step`。

使用谷歌的富媒体搜索结果测试工具进行验证。

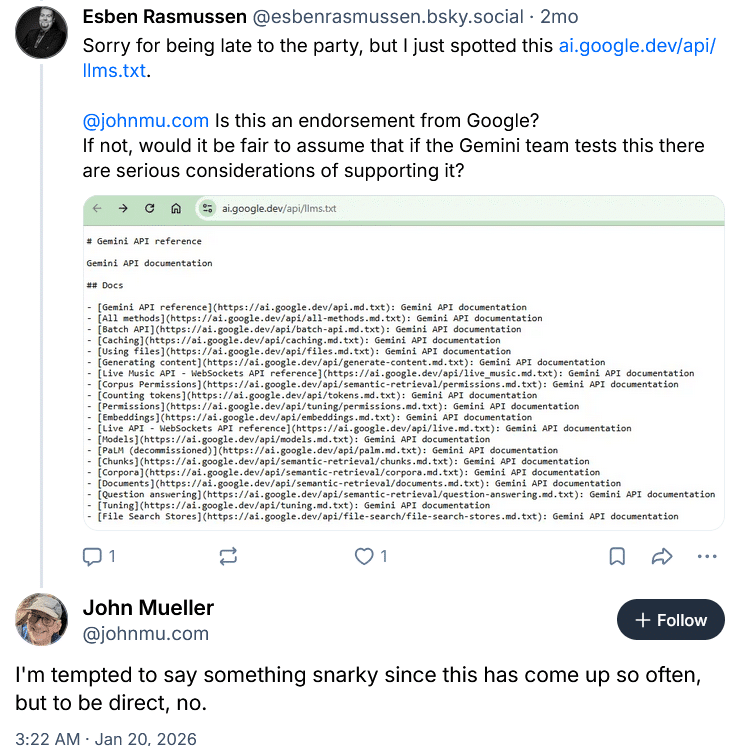

谷歌富媒体结果测试工具界面截图,显示HowTo Schema标记验证成功 - 优化HTML语义结构:正确使用`

`到`

`的标题标签,构建清晰的内容大纲。将关键事实和数据放在段落开头或使用``标签适度强调。避免将所有重要内容塞进图片(AI无法直接读取图片中的文字)。

- 谨慎使用JavaScript渲染关键内容:如果核心内容依赖JavaScript加载,确保网站采用了动态渲染或混合渲染技术,以便无头浏览器(AI爬虫常用)能够获取到完整内容。

| 内容类型 | 推荐Schema类型 | 关键属性 | 对AI代理的价值 |

|---|---|---|---|

| 产品评测 | Product + Review | reviewRating, author, datePublished | 快速提取评分、评价要点、发布时间,用于生成对比摘要。 |

| 菜谱 | Recipe | cookTime, recipeIngredient, recipeInstructions | 直接提取食材清单和步骤,整合进AI生成的烹饪指南。 |

| 常见问题解答 | FAQPage | question, acceptedAnswer | 以Q&A对的形式提供信息,是AI最易提取和引用的格式之一。 |

第三步:提升内容可靠性与权威信号

本节解决:在众多信息来源中,如何让AI认为你的内容更可信、更值得引用?

谷歌的E-E-A-T(经验、专业、权威、可信)准则在生成式搜索时代被放大。AI代理倾向于引用那些表现出高度权威性和可信度的来源,以减少生成“幻觉”或错误信息的风险。

操作步骤:向AI发送“可信”信号

- 强化作者与网站权威性:

- 为每位作者创建详细的“关于”页面,使用`Person` Schema标记其资历、所属组织。

- 在网站显著位置展示行业认证、奖项、权威媒体引用(如 Forbes、TechCrunch 的报道链接)。

- 提供透明且可追溯的数据来源:当引用数据、研究结果时,不要只说“研究表明”。要提供:

- 研究机构名称(如“哈佛大学公共卫生学院”)

- 研究报告标题或链接

- 数据发布日期

这为AI提供了验证路径,极大增强了内容的可信度。

- 保持内容的时效性与更新记录:对于时间敏感的主题(如科技、金融、健康建议),明确标注文章的“最初发布日期”和“最后更新日期”。AI会更倾向于引用最新的信息。在页面中注明“本文于[日期]更新,以反映最新信息”。

案例:一个健康资讯网站的权威性建设

场景:一个提供营养建议的网站,希望在AI生成的健康问答中被引用。

问题:其文章虽然质量高,但作者信息模糊,数据来源标注不清。

操作:

1. 为所有撰稿的注册营养师创建个人资料页,关联其专业执照编号和`Person` Schema。

2. 在每篇涉及健康数据文章中,添加“参考文献”部分,链接到PubMed等权威学术数据库的原研究。

3. 对过时的文章进行全面审查和重写,并在顶部添加“最后医学审查日期”。

结果:6个月后,该网站在涉及营养学问题的SGE回答中,被列为“来源”的频率显著增加。通过第三方SGE追踪工具监测,其品牌在相关AI摘要中的出现率提升了25%,并带动了品牌搜索量的增长。

总结与立即行动清单

生成式搜索不是要取代SEO,而是将其推向一个更精细、更注重质量和可信度的新阶段。技术SEO是这一切的基础。以下是你可以立即开始的行动清单:

- 行动一:审计爬虫访问 – 工具:分析服务器日志文件(可用Screaming Frog Log File Analyzer)。操作:检查是否有AI爬虫被`robots.txt`或服务器设置意外屏蔽,特别是对你核心内容目录的访问。预期结果:确保所有重要的AI信息采集器都能抓取你的内容。

- 行动二:实施关键Schema标记 – 工具:谷歌富媒体结果测试工具、Schema标记生成器(如 Merkle‘s Schema Markup Generator)。操作:为你最主要的内容类型(文章、产品、常见问题)添加至少一种最相关的Schema标记,并通过谷歌工具验证。预期结果:让AI能无歧义地理解你页面中的核心实体和事实。

- 行动三:优化内容HTML结构 – 工具:浏览器开发者工具、SEO爬虫(如Screaming Frog)。操作:检查关键内容是否被正确的标题标签组织,重要数据是否隐藏在JS元素中需要优化渲染,确保文本内容可被直接提取。预期结果:降低AI提取信息的难度和错误率。

- 行动四:增强作者与来源可信度 – 方法:创建详细的作者页面并添加`Person` Schema,在文章中明确引用权威数据来源(提供机构名称、报告链接、日期)。预期结果:向AI发送强烈的E-E-A-T信号,提高内容被选为可靠引用的概率。

- 行动五:建立内容更新机制 – 方法:对时效性强的旧内容进行审查和更新,并在页面中清晰标注“最后更新日期”。预期结果:使你的内容在AI看来始终保持“新鲜”和“相关”,避免因信息过时而被忽略。

技术SEO的战场已经扩展。今天,你的对手不仅是竞争对手的网站,还有AI对信息理解的“黑箱”。通过上述具体、可操作的技术调整,你能显著提高内容在生成式搜索时代的“能见度”与“引用率”,在AI驱动的搜索未来中占据有利位置。